Wie wird Künstliche Intelligenz im Journalismus wahrgenommen? Kennzeichnung steigert Erkennbarkeit und Transparenz

Künstliche Intelligenz (KI) wird zunehmend wichtig – sowohl im Alltag vieler Menschen als auch im Journalismus. Der aktuelle Transparenz-Check der Medienanstalten zeigt: Der Einsatz von KI im Journalismus wird allgemein eher skeptisch betrachtet. Es wird befürchtet, dass KI das Vertrauen in Nachrichten, z. B. durch das Erstellen von Falschinformationen, untergraben könnte. Die Akzeptanz von KI variiert je nach journalistischem Einsatzbereich und ist vor allem bei der Überprüfung von Texten und Informationen sowie bei der Themenrecherche relativ hoch. KI-Kennzeichnungen werden grundsätzlich als hilfreich empfunden, um KI-generierte Inhalte zu erkennen.

Künstliche Intelligenz vor allem bei jungen, hochgebildeten Menschen ein großes Thema

Im Journalismus und für Redaktionen spielt KI eine immer wichtigere Rolle und wird derzeit bereits in vielfältiger Form eingesetzt. Immer mehr Redaktionen nutzen KI; beispielsweise um Artikel automatisch zusammenzufassen, die redaktionelle Bearbeitung zu unterstützen, große Datenmengen zu analysieren oder zur Weiterbildung von Journalist:innen.

Ebenso ist KI für viele Internetnutzer:innen bereits ein Thema, über das sie auch im Privaten sprechen. Es zeigen sich allerdings starke demografische Unterschiede. Vor allem jüngere Internetnutzer:innen sowie Menschen mit höherem formalen Bildungsstand setzen sich eher mit KI auseinander und sind folglich auch besser über KI informiert. Dennoch schätzt die Mehrheit der Internetnutzer:innen ihr Wissen rund um KI als eher schlecht ein.

Hier sollte ein Diagramm sein. Leider kann es nicht dargestellt werden.Wahrscheinlich fehlt die Javascript-Unterstützung in Ihrem Browser.

Insgesamt haben 41 Prozent aller Befragten bereits mindestens ein KI-Angebot genutzt. Diese Erfahrungen basieren vor allem auf der Nutzung von ChatGPT. Dieses Tool wurde von knapp einem Drittel bereits genutzt, weitere 35 Prozent kennen das Angebot, haben es aber noch nicht ausprobiert. Andere KI-Angebote, wie DeepL, Co-Pilot, Bard, Dall-E oder MidJourney, sind nur wenigen Internetnutzer:innen bekannt und werden nur von einer Minderheit genutzt.

Hier sollte ein Diagramm sein. Leider kann es nicht dargestellt werden.Wahrscheinlich fehlt die Javascript-Unterstützung in Ihrem Browser.

Bei denjenigen, die bereits im Freundes-/Bekanntenkreis über KI diskutieren, ihr Wissen zu KI als sehr/eher gut einschätzen und darüber hinaus mindestens zwei KI-Tools genutzt haben, sprechen wir von Internetnutzer:innen mit hoher KI-Affinität. Sie sind in der Regel jünger, eher männlich, verfügen über eine hohe formale Bildung und weisen ein eher hohes Medienvertrauen auf.

Auswirkungen von KI auf den Journalismus werden eher skeptisch betrachtet

Im Allgemeinen schauen die Internetnutzer:innen mit gemischten Gefühlen auf die Auswirkungen von KI. Die Mehrheit sieht sowohl positive als auch negative Auswirkungen von KI in den nächsten 10 Jahren. KI-Affine sind hier deutlich optimistischer. Knapp die Hälfte von ihnen gibt an, dass KI eher positive oder sehr positive Auswirkungen haben wird. Dagegen erwarten vor allem Personen mit niedrigem Medienvertrauen negative Auswirkungen von KI auf ihr zukünftiges Leben.

Hier sollte ein Diagramm sein. Leider kann es nicht dargestellt werden.Wahrscheinlich fehlt die Javascript-Unterstützung in Ihrem Browser.

Im Bereich des Journalismus sind die Internetnutzer:innen skeptischer. Hier befürchten fast 40 Prozent der Befragten eher negative oder sehr negative Auswirkungen. Der Grund dafür liegt unter anderem in der Sorge vieler Nutzer:innen, dass durch KI das Vertrauen in Nachrichten und Medieninhalte sinkt. So könnte durch den Einsatz von KI im Journalismus die Täuschungsgefahr erhöht oder das Erstellen von Falschinformationen erleichtert werden und zum Abbau von Arbeitsplätzen führen. Positive Folgen von KI fallen weniger ins Gewicht – außer bei den KI-Affinen, die stärker die Chancen sehen, die sich durch KI für den Journalismus ergeben.

Hier sollte ein Diagramm sein. Leider kann es nicht dargestellt werden.Wahrscheinlich fehlt die Javascript-Unterstützung in Ihrem Browser.

Die Akzeptanz des Einsatzes von KI im Journalismus unterscheidet sich dabei deutlich nach dem Bereich, in dem KI genutzt wird. So wird der Einsatz von KI beim Überprüfen von Texten und Informationen sowie bei der Themenrecherche von knapp drei Viertel der Internetnutzer:innen als akzeptabel bewertet. Dagegen werden komplett mithilfe von KI geschriebene Artikel von über 70 Prozent der Nutzer:innen als inakzeptabel abgelehnt. Auch gegen die Nutzung von KI-Stimmen, die bekannte Moderator:innen nachahmen, sowie die Verwendung eines KI-Avatars sprechen sich etwa zwei Drittel der Nutzer:innen aus.

Hier sollte ein Diagramm sein. Leider kann es nicht dargestellt werden.Wahrscheinlich fehlt die Javascript-Unterstützung in Ihrem Browser.

Beim Erkennen von KI ist eine Kennzeichnung hilfreich

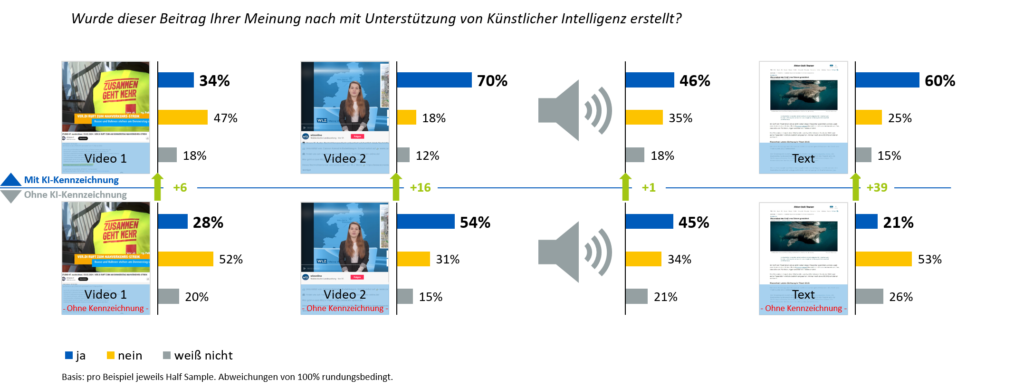

Um herauszufinden, wie gut die Befragten erkennen können, ob Beiträge mithilfe von KI erstellt wurden, wurden verschiedene Praxisbeispiele getestet (zum detaillierten Vorgehen s. „Über die Studie“). Es zeigt sich, dass das Erkennen von KI-basierten Beiträgen für die Befragten teilweise schwierig ist. Eine entsprechende Kennzeichnung erhöht in jedem Fall die Sichtbarkeit des KI-Einsatzes und sorgt – sofern sie wahrgenommen wird – für mehr Transparenz. Die Sichtbarkeit und die damit einhergehende Hinweisstärke der Kennzeichnung unterscheiden sich zwischen den getesteten Beispielen stark.

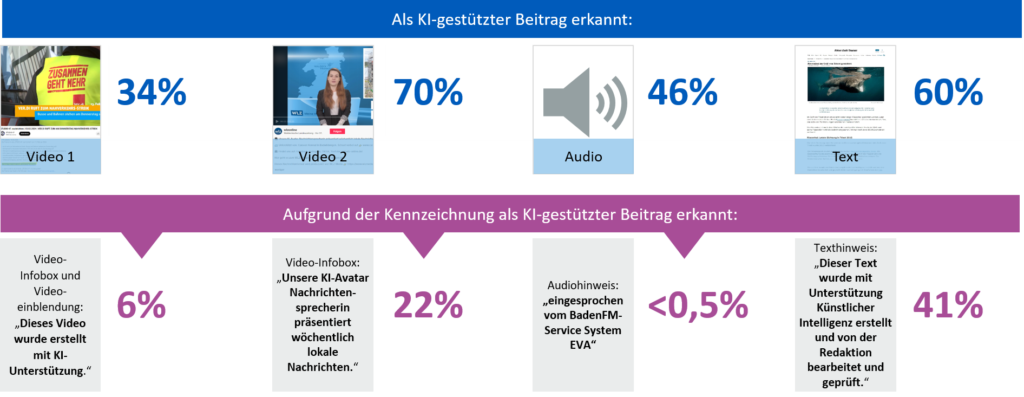

Ein textlicher Hinweis („Dieser Text wurde mit Unterstützung Künstlicher Intelligenz erstellt und von der Redaktion bearbeitet und geprüft. Mehr zum Umgang mit KI erfahren Sie hier.“) in einem Textbeitrag funktioniert dabei am besten – und für alle ähnlich gut. Mit KI-Kennzeichnung nehmen im Vergleich zur Nicht-Kennzeichnung weitere 39 Prozent der Befragten den KI-Einsatz wahr. Am schlechtesten schneidet der Sprecherhinweis (KI-generierte Stimmt sagt „eingesprochen vom BadenFM-Service-System EVA“) in einem Audio-Beitrag ab. Dieser wurde von kaum jemandem als entscheidender Hinweis auf den KI-Einsatz empfunden. Die getesteten Kennzeichnungen in den Videobeiträgen wurden nur von 6 bzw. 22 Prozent der Befragten als wichtigste Hilfestellung wahrgenommen. Dabei nehmen Jüngere die Hinweise in Video oder Infoboxen deutlich häufiger wahr als Ältere. Trotzdem erhöht auch hier die Kennzeichnung das Erkennen des KI-Einsatzes von 28 auf 34 Prozent bzw. von 54 auf 70 Prozent.

Ob ein KI-Einsatz erkannt wird, hängt daher insbesondere in audiovisuellen Beiträgen nicht nur von der Kennzeichnung, sondern auch stark von anderen Faktoren ab. Die wichtigsten Erkennungssignale – wichtiger als die Kennzeichnung aktuell – sind Stimme und Tonalität im Beitrag sowie der Einsatz von Avataren. Bei textbasierten Beiträgen fehlen diese Signale, sodass das Erkennen ohne entsprechende Kennzeichnung nur schlecht gelingt.

Daher überrascht es kaum, dass die Internetnutzer:innen klare Regeln sowie die Kennzeichnung von KI-basierten Beiträgen als sehr wichtig ansehen. Auch Kennzeichnungspflichten stehen die Nutzer:innen dabei sehr positiv gegenüber – eine Unterscheidung zwischen den verschiedenen Einsatzbereichen von KI machen die Nutzer:innen dabei nicht.

Das Ziel von Kennzeichnung soll sein, dass möglichst alle Nutzer:innen erkennen können, ob KI bei der Erstellung von Beiträgen genutzt wurde. Der Transparenz-Check zeigt, dass dies in textbasierten Beiträgen bereits gut funktioniert, in Audio- und Video-Beiträgen aber noch ausbaufähig ist. Aktuell können vor allem jüngere Nutzer:innen die Nutzung von KI anhand der Kennzeichnung besser erkennen, während bei Video-Beiträgen insbesondere ältere Menschen damit größere Probleme haben.

Kennzeichnungen nicht nur beim Thema KI wichtig

Die Ergebnisse dieses Transparenz-Checks reihen sich dabei in die Erkenntnisse der vorherigen Transparenz-Checks zu Werbung bei Podcasts und zu Werbekennzeichnung in Social Media ein: Werbung bzw. KI-Einsatz wird mit Kennzeichnung häufiger und besser erkannt – wenn die Kennzeichnung gut sichtbar ist. Mit über 70 Prozent ist sich die große Mehrheit der Nutzer:innen in allen drei Transparenz-Checks darüber einig, dass es sowohl für die Werbung als auch für den Einsatz von KI in Medien klare Regeln geben sollte.

In einer Gesellschaft, in der Digitalisierung und KI eine immer größere Rolle spielen, ist es wichtig, dass Transparenz hergestellt wird. Nutzer:innen müssen wissen, womit sie es zu tun haben – ob mit KI-Journalismus oder Werbung. Die Einordnung von Medieninhalten, das Erkennen von werblichen Inhalten oder dem KI-Einsatz fällt nicht allen Menschen leicht, insbesondere ältere und digital weniger affine Menschen tun sich damit schwer. Dass Kennzeichnung hilft, wurde bereits mehrfach gezeigt. Und auch bei KI im Journalismus sollte auf Kennzeichnung gesetzt werden. Ähnlich wie in Podcasts oder bei Social-Media-Videos hilft es, wenn die Kennzeichnung prominent platziert ist und so disruptiv ist, dass sie auch mit hoher Wahrscheinlichkeit wahrgenommen wird – nur so kann sie ihre Wirkung entfalten.

Über die Studie

pollytix strategic research gmbh führte im Auftrag der medienanstalten vom 30. Mai bis 11. Juni 2024 eine repräsentative Online-Studie unter Internetnutzer:innen in Deutschland durch. Insgesamt wurden 3.013 Personen ab 16 Jahren befragt. Ziel der Befragung war es, zu überprüfen, ob Teilnehmer:innen verschiedene Beitragsarten, die mit KI-Unterstützung generiert wurden, als solche erkennen und zu erfahren, inwiefern eine Kennzeichnung die Sichtbarkeit des KI-Einsatzes erhöht.

Den Teilnehmer:innen der Studie wurden dafür jeweils vier Praxisbeispiele unterschiedlicher Art vorgelegt (zwei Videobeiträge, ein Audiobeitrag sowie ein textbasierter Beitrag). Alle vier genutzten Beispiele sind unter Verwendung von KI entstanden und auf unterschiedliche Art und Weise gekennzeichnet. Um Wahrnehmung, Signalwert und Relevanz der Kennzeichnung zu bewerten, wurden die vier Beispiele im A/B-Testing jeweils einmal mit und einmal ohne Kennzeichnung getestet.

Im Anschluss an die Rezeption des Beispiels wurden die Proband:innen jeweils um eine Bewertung des Beitrags entlang verschiedener Kategorien gebeten. Darüber hinaus wurde gefragt, ob der Beitrag unter Verwendung von KI entstanden ist. Falls ja, wurde anschließend nach einer Begründung für diese Einschätzung gefragt.

Für weitere Analysen wurden zudem Fragen zu soziodemographischen Angaben, beispielsweise Alter, Bildung oder Wohnort, sowie Fragen zu Mediennutzung, Medienwissen und allgemeinen Einstellungen gegenüber KI gestellt.

Leonie Schulz studierte Medien- und Politikwissenschaft sowie politische Kommunikation in Leipzig, Lyon und Berlin. Sie arbeitet als Seniorberaterin bei der Forschungs- und Beratungsagentur pollytix strategic research gmbh. Hier ist sie vor allem für quantitative Forschungsprojekte und Analysen verantwortlich. Ihre thematischen Schwerpunkte liegen im Bereich Wahlforschung und politische Kommunikation.

Lutz Ickstadt studiertePolitikwissenschaft und Öffentliches Recht sowie Empirische Demokratieforschung in Mainz, Gent und Lincoln. Er arbeitet als Senior Berater bei der Forschungs- und Beratungsagentur pollytix strategic research gmbh. Hier ist er vor allem für quantitative Forschungsprojekte und Analysen verantwortlich. Seine thematischen Schwerpunkte liegen im Bereich Wahl- und Medienforschung.